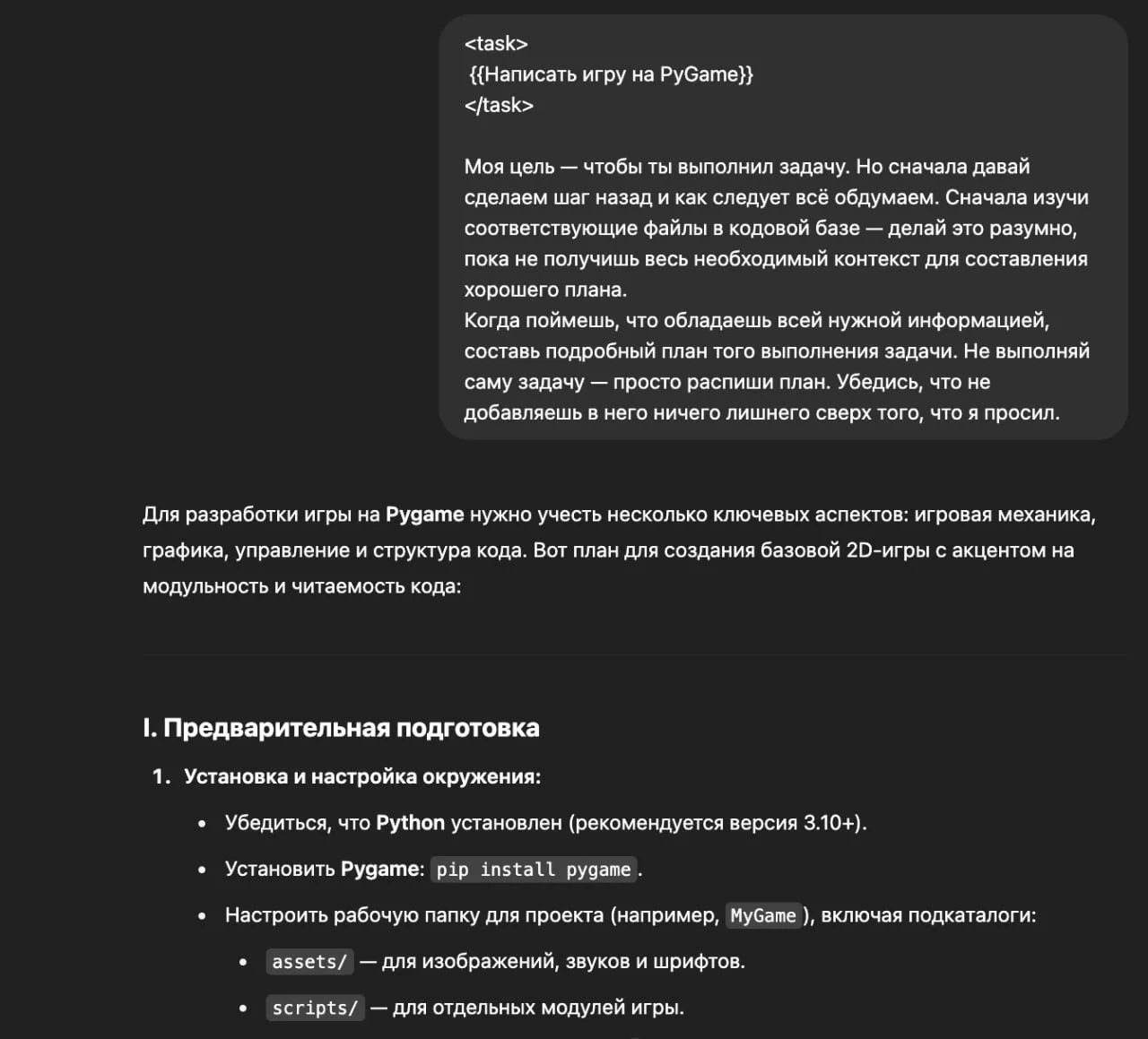

Нашли имбовый промт для кодеров: если работаете с нейросетью, начните с того, чтобы попросить её исследовать задачу и составить план. Это помогает ей мыслить логично и быстрее выдавать рабочий код:

Моя цель — чтобы ты выполнил задачу. Но сначала давай сделаем шаг назад и как следует всё обдумаем. Сначала изучи соответствующие файлы в кодовой базе — делай это разумно, пока не получишь весь необходимый контекст для составления хорошего плана. Когда поймешь, что обладаешь всей нужной информацией, составь подробный план выполнения задачи. Не выполняй саму задачу — просто распиши план. Убедись, что не добавляешь в него ничего лишнего сверх того, что я просил.

Если пишете код с нуля, просто уберите строку «Сначала изучи соответствующие файлы…».

Пользуемся.